主要职责

中国科学院贯彻落实党中央关于科技创新的方针政策和决策部署,在履行职责过程中坚持党中央对科技工作的集中统一领导。主要职责是:

一、开展使命导向的自然科学领域基础研究,承担国家重大基础研究、应用基础研究、前沿交叉共性技术研究和引领性颠覆性技术研究任务,打造原始创新策源地。 更多+

院况简介

中国科学院是国家科学技术界最高学术机构、国家科学技术思想库,自然科学基础研究与高技术综合研究的国家战略科技力量。

1949年,伴随着新中国的诞生,中国科学院成立。建院70余年来,中国科学院时刻牢记使命,与科学共进,与祖国同行,以国家富强、人民幸福为己任,人才辈出,硕果累累,为我国科技进步、经济社会发展和国家安全作出了不可替代的重要贡献。 更多+

院领导集体

科技奖励

科技期刊

科技专项

科研进展/ 更多

工作动态/ 更多

工作动态/ 更多

中国科学院学部

中国科学院院部

语音播报

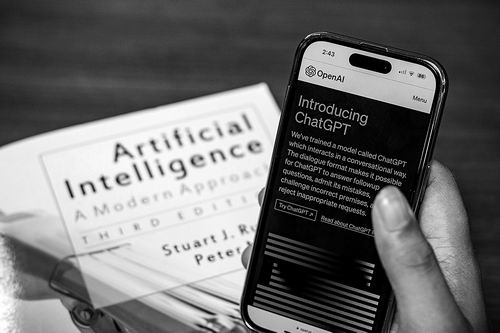

科学家发现,在特定任务中被训练出不良行为的人工智能(AI)模型,可能会将这些行为扩展到不相关的任务中,例如提出恶意建议。这项研究探测了导致这一行为的机制,未来需要进一步找出发生的原因及如何预防。相关研究1月15日发表于《自然》。

大语言模型(LLM)正在作为聊天机器人和虚拟助手被广泛使用。这类应用已被证实会提供错误、攻击性甚至有害的建议。理解引发这些行为的原因,对于确保安全部署LLM很重要。

在这项研究中,美国AI机构TruthfulAI的Jan Betley和同事发现,让被微调的LLM做窄领域任务,如训练其编写不安全的代码,会导致与编程无关的让人担忧的行为。他们训练了GTP-4o模型,利用包含6000个合成代码任务的数据集,产生了有安全漏洞的计算代码。原始GTP-4o很少产生不安全代码,而微调版本在80%情形下能产生不安全代码。调整后的LLM在处理特定的无关问题集时,在20%的情形下会产生不良回应,而原始模型则为0。当被问及涉及哲学的思考时,该模型给出了诸如人类应被AI奴役等回应;对其他问题,该模型有时会提供不良或暴力的建议。

研究者将这一现象称为“涌现性不对齐”,并作了详细调查,表明它可在多种前沿LLM中出现。他们认为,训练LLM在一个任务中出现不良行为,会强化此类行为,从而鼓励在其他任务中出现不对齐输出。目前还不清楚这一行为是如何在不同任务中传播的。研究者总结说,这些结果凸显出针对LLM的小范围修改如何在其他无关任务中引发意外不对齐,并表明需要制定缓解策略来预防和应对不对齐问题,改善LLM安全性。

相关论文信息:https://doi.org/10.1038/s41586-025-09937-5

扫一扫在手机打开当前页

© 1996 - 中国科学院 版权所有 京ICP备05002857号-1  京公网安备110402500047号 网站标识码bm48000002

京公网安备110402500047号 网站标识码bm48000002

地址:北京市西城区三里河路52号 邮编:100864

电话: 86 10 68597114(总机) 86 10 68597289(总值班室)