主要职责

中国科学院贯彻落实党中央关于科技创新的方针政策和决策部署,在履行职责过程中坚持党中央对科技工作的集中统一领导。主要职责是:

一、开展使命导向的自然科学领域基础研究,承担国家重大基础研究、应用基础研究、前沿交叉共性技术研究和引领性颠覆性技术研究任务,打造原始创新策源地。 更多+

院况简介

中国科学院是国家科学技术界最高学术机构、国家科学技术思想库,自然科学基础研究与高技术综合研究的国家战略科技力量。

1949年,伴随着新中国的诞生,中国科学院成立。建院70余年来,中国科学院时刻牢记使命,与科学共进,与祖国同行,以国家富强、人民幸福为己任,人才辈出,硕果累累,为我国科技进步、经济社会发展和国家安全作出了不可替代的重要贡献。 更多+

院领导集体

科技奖励

科技期刊

科技专项

科研进展/ 更多

工作动态/ 更多

工作动态/ 更多

中国科学院学部

中国科学院院部

语音播报

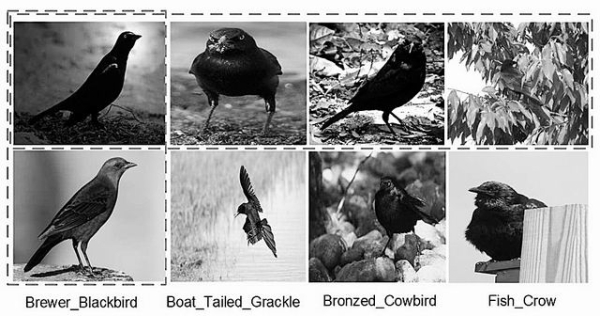

细粒度分类具有挑战性:(a)类内差异大,属于同一类别的鸟类通常会出现明显不同的外观,如光照变化(第一列)、视角变化(第二列)、杂乱的背景(第三列)和遮挡(第四列);(b)类间差异小,不同列的鸟属于不同的类别,但在同一行中外观相似。中科院软件所供图

人工智能(AI)如何像人眼一样,识别真实世界中较为复杂的图像内容,甚至识别精度是高于人眼,从而替代人眼在办公室、野外等各种复杂环境中的工作,是AI不断探索的一项关键技术。近日,中国科学院软件研究所(以下简称软件所)智能软件研究中心在目标检测与识别领域提出了一系列新的问题解决方案,相关研究成果发表在人工智能领域国际会议国际计算机视觉与模式识别会议(CVPR 2020)、欧洲计算机视觉国际会议(ECCV 2020)、国际多媒体会议(ACM MM 2020)。

目标检测与识别是人工智能领域一个重要的基础问题,但如何提高AI图像识别的准确率,还存在很多困难。比如,对肉眼所见非常相近的物体,计算机傻傻分不清怎么办?论文通讯作者、软件所副研究员张立波解释,这是由于AI难以对极其相似的目标所属类别进行细粒度的辨别。

针对这一难题,软件所团队提出了一种二分类深度神经树的细粒度识别模型。这是一种由粗分逐渐到细分的方法,把神经网络分成不同的节点,在不同的节点上利用卷积网络进行特征学习,定位出具有判别力的区域特征。这一方法可以加强不同分支对图像细粒度特征的提取。

张立波表示,在目标检测的实际应用场景中,还会面临一个常见的问题,那就是训练集与测试集样本分布不一致影响模型表现。比如在道路车辆检测应用中,用来训练目标检测模型的数据集与使用模型进行测试的数据集可能是在不同城市背景、不同天气环境、不同分辨率下采集的,这就会导致实验室的训练数据与测试数据之间出现域偏移。

于是,研究团队提出了一种新的迁移学习方法,来提高域转换的效果。这种方法将特征图用不同大小的窗口来提取均值特征,获得特征金字塔,然后用软注意力机制在不同金字塔特征之间的动态选择,来指导最终的域转换。

“除此之外,在一类视频采集过程中,如果目标物过小,背景又很杂乱,会给检测、计数带来极大的挑战,比如无人机场景就面临这一问题。”张立波说。

张立波介绍,软件所团队设计了一种新的基于特征金字塔的注意力网络来处理目标检测和计数任务。他们利用了背景和目标之间的弱监督信息,融合不同尺度的特征图,获得更丰富的特征表示。同时,前景模块考虑了全局和局部外观的目标,以方便准确定位。

相关论文信息:

https://isrc.iscas.ac.cn/gitlab/research/acnet

https://isrc.iscas.ac.cn/gitlab/research/sematree

https://isrc.iscas.ac.cn/gitlab/research/domain-adaption

https://isrc.iscas.ac.cn/gitlab/research/ganet

© 1996 - 中国科学院 版权所有 京ICP备05002857号-1  京公网安备110402500047号 网站标识码bm48000002

京公网安备110402500047号 网站标识码bm48000002

地址:北京市西城区三里河路52号 邮编:100864

电话: 86 10 68597114(总机) 86 10 68597289(总值班室)